摘要:目前,初創公司和科技巨頭競相打造加速器,讓人工智能能夠應對現實世界的復雜性。一大批老牌公司和初創企業正在制造特殊用途芯片,以將人工智能技術的能力提升到一個新的水平。

目前,初創公司和科技巨頭競相打造加速器,讓人工智能能夠應對現實世界的復雜性。一大批老牌公司和初創企業正在制造特殊用途芯片,以將人工智能技術的能力提升到一個新的水平。這些新芯片旨在幫助人工智能掌握人類語言的微妙之處,并處理自動駕駛汽車的細微差別,比如汽車制造商特斯拉正在開發的自動駕駛汽車。

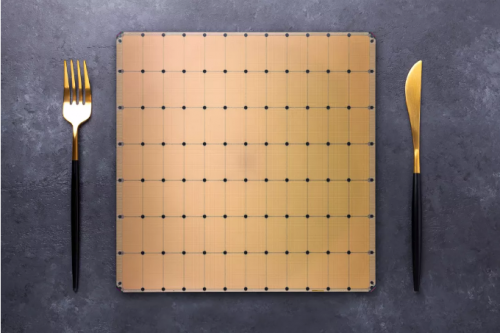

以數十年來一直珍視微型化的芯片行業的標準來看,一些新芯片是巨大的。一個用于人工智能加速的芯片占地46,225平方毫米,由2.6萬億晶體管組成,據其設計者Cerebras估計,這是有史以來最大的。

英特爾、谷歌、高通和蘋果正在進行更傳統的人工智能芯片工作,這些公司的處理器被設計用于運行人工智能軟件和許多其他任務。但最大的芯片來自于行業稱霸的英偉達(Nvidia)和新一代初創公司,包括Esperanto Technologies、Cerebras、GraphCore和SambaNova Systems。他們的進步可能會推動人工智能遠遠超越其目前在篩查垃圾郵件、編輯照片和支持面部識別軟件方面的作用。

Cerebras 的 WSE-2 AI 加速器芯片由一組矩形處理器元件組成,每個元件都與非常大的傳統芯片一樣大,它們共同占據了整個硅晶片的大部分面積。

這一系列設計的背后,是人們對人工智能是下一個技術淘金熱的期待。通過模仿人類大腦的某些方面來工作的人工智能系統,在模式識別和決策方面正在迅速改進。由于人工智能有可能應對現實世界的復雜性,特斯拉和無人機制造商Skydio等公司押注人工智能將讓它們的車輛自動駕駛。Cerebras 的 WSE-2 AI 加速器芯片由一組矩形處理器元件組成,每個元件都與非常大的傳統芯片一樣大,它們共同占據了整個硅晶片的大部分面積。

本周早些時候,這兩家芯片初創公司在Hot Chips大會上公布了他們的設計。此次會議召開之前,特斯拉剛剛詳細介紹了其雄心勃勃的Dojo AI培訓技術和其核心的D1處理器。在人工智能日活動上,特斯拉首席執行官埃隆·馬斯克表示,人工智能技術甚至可以幫助類人機器人特斯拉機器人(Tesla Bot)在現實世界中導航。

更強大的人工智能意味著進步不會被人工智能訓練的緩慢過程所阻礙。Open AI的GPT-3是一款備受矚目的用于生成人類可讀文本的人工智能系統,它花了4個月的時間來訓練。

巨大的人工智能芯片

每天的計算工作,比如查看電子郵件或流媒體視頻,大多都涉及一個單獨的計算任務,稱為線程。然而,訓練一個AI模型需要一個能夠一次處理更多線程的系統。

451 Group分析師James Sanders表示:“在大規模并行的情況下,人工智能的工作負載表現得最好。”根據人工智能算法和數據的特殊需求定制的人工智能芯片,與其他處理器一樣,從300毫米的晶片開始,但最終幾乎是業內最大的。

Esperanto的ET-SOC-1處理器是570平方毫米,有240億個晶體管,聯合創始人Dave Ditzel在Hot Chips上說。特斯拉的D1處理器是其剛剛開始構建的Dojo人工智能培訓系統的基礎,Dojo領導人Ganesh Venkataramanan說,該處理器的面積為645平方毫米,有500億個晶體管。Graphcore的Colossus Mk2為823平方毫米,590億個晶體管。

更大的Cerebras AI 芯片

Cerebras在芯片大小上處于另一個聯盟。

在普通處理器被從一個300毫米的晶圓上切割成十多個或上百個的地方,Cerebras保留了完整的晶圓,從而制造出一個單獨的WSE-2 AI加速處理器。芯片制造設備每次只能在晶圓上一個相對較小的矩形區域上蝕刻晶體管電路。但Cerebras設計了每一個矩形晶片元件,這樣它們就可以在晶片上互相交流。

其他人工智能芯片公司也將它們的芯片連接在一起——特斯拉的Dojo將3000塊D1芯片組合成一個名為Exapod的單元。但Cerebras的芯片將集成更進一步。

人工智能芯片的挑戰

制造人工智能加速芯片并不容易。英特爾放棄了其首款人工智能芯片Nervana,創業公司Wave Computing在2020年申請了破產保護,今年開始嘗試更普通的芯片許可業務。

而用于訓練人工智能系統的現有技術高端圖形芯片依然強大。例如,特斯拉目前的人工智能培訓系統使用的是英偉達的圖形芯片。英偉達電腦架構師Ritika Borkar在推特上表示,圖形芯片的靈活性有助于公司應對人工智能領域更短的周期,該領域的技術大約每18個月就會發生變化。

編輯/梁靜